CN / EN

CN / EN

ARKit 5新功能:位置定位及动作捕捉的改进

有些事情似乎就是让人难以忘怀

去年推出时,它的重点是提供应用程序中的工具和服务。所有的应用剪辑代码都是通过可扫描的模式或者NFC提供的。人们使用摄像头或NFC扫描代码来启动应用剪辑。

今年,苹果在应用剪辑和应用剪辑代码中增强了AR支持,现在可以在AR体验中识别和跟踪应用剪辑代码——所以你可以在不运行整个应用程序的情况下运行部分AR体验。

这意味着在客户体验方面,公司可以创建一个增强现实体验变得可用当客户点相机应用程序代码的产品参考手册、海报,在页的一本杂志,在贸易展店——无论你需要他们找到该资产。

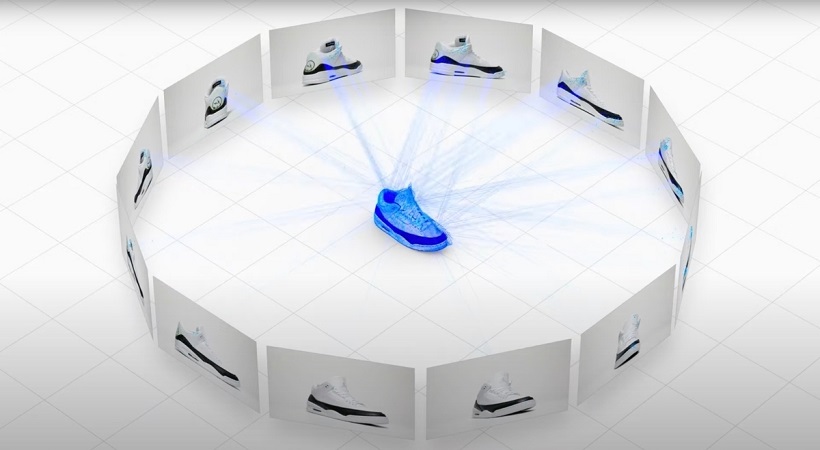

对象捕捉

苹果还在2021年WWDC上推出了一个重要的支持工具,即RealityKit中的对象捕获2。这使得开发者可以更容易地使用iPhone、iPad或单反拍摄的图像快速创建现实世界物体的逼真3D模型。

这本质上意味着,苹果已经从授权开发者创建只存在于应用程序内部的AR体验,转向创建可移植的AR体验,或多或少可以在应用程序之外工作。

这一点意义重大,因为它有助于创建一个AR资产、服务和体验的生态系统,而这正是谷歌在这个领域进一步推进时所需要的。

需要更快的处理器

了解能够运行此类内容的设备类型很重要。当ARKit首次与iOS 11一起推出时,苹果表示它至少需要一个A9处理器才能运行。从那以后,事情发生了变化,ARKit 5中最复杂的功能需要至少一个A12仿生芯片。

在这种情况下,App Clip Code跟踪需要使用A12 Bionic处理器或更高版本的设备,比如iPhone XS。这些体验需要苹果最新推出的一款处理器,这一点值得注意,因为苹果正坚定不移地推动AR眼镜的发布。

这有助于理解苹果投资芯片开发的战略决策。毕竟,从A10 Fusion处理器到A11处理器的转变带来了25%的性能提升。在这一点上,苹果的每一代芯片似乎都取得了大致相同的收益。一旦它在2022年转向3nm芯片,我们应该会看到它在每瓦性能上的另一个飞跃——这些性能上的进步现在可以在它的各个平台上使用,这要感谢m系列Mac芯片。

尽管拥有如此强大的功能,但苹果警告称,解码这些片段可能需要时间,因此建议开发者在奇迹发生时提供占位符可视化。

ARKit 5还有什么新功能?

除了应用剪辑代码,ARKit 5还有以下优点:

位置定位

现在可以将AR内容放置在特定的地理位置,并将体验绑定到地图的经度/纬度测量。这项功能还需要A12或更高版本的处理器,美国主要城市和伦敦都有这一功能。

这意味着,你可以通过将相机对准一个标志,或在地图上查看某个位置,四处闲逛,获得增强现实体验。这种叠加的现实必须是该公司计划的一个暗示,特别是与其在可访问性、人识别和行走方向方面的改进相一致。

动作捕捉的改进

ARKit 5现在可以在更长的距离更准确地跟踪身体关节。运动捕捉也更准确地支持更广泛的肢体运动和身体姿势在A12或更高的处理器。不需要修改代码,这意味着任何使用这种方式的动作捕捉的应用程序将在iOS 15发布后获得更好的准确性。

青瞳视觉编译,其目的是为了将更好的内容分享给更多人,版权依旧归原作者所有。若有涉及侵权请予以告知,我们会尽快在24小时内删除相关内容,谢谢。

- Prev:捕捉时间,预测人类运动

- Back

- Next:美国国立卫生研究院运用动捕系统资助儿童口吃创新研究